Embodied Mobile Agents Group

"Wir bringen Intelligenz in die physische Welt (Physical AI), indem wir Robotern und Maschinen ermöglichen, sich durch Interaktion zu bewegen, zu handeln und zu lernen. Unsere Forschung befasst sich mit dem Lernen mobiler Roboter und dem verstärkenden Lernen und befindet sich an der Schnittstelle zwischen generativer KI und Robotik mit agentenbasierten Systemen für verkörperte Intelligenz in der mobilen Robotik."

Expertise

- Reinforcement Learning

- Mobile Robot Learning

- Grundlagenmodelle in der mobilen Robotik (z. B. Vision-Language-Action-Modelle)

- Verstärkendes Lernen und adaptive Steuerung für mobile und verkörperte Roboter

- Lernen aus Demonstrationen und Sim-to-Real-Transfer

- Vision-Language-Action-Modelle (VLA) und Roboterschnittstellen mit natürlicher Sprache

- Menschzentrierte und agentenbasierte KI für intuitive Mensch-Roboter-Zusammenarbeit

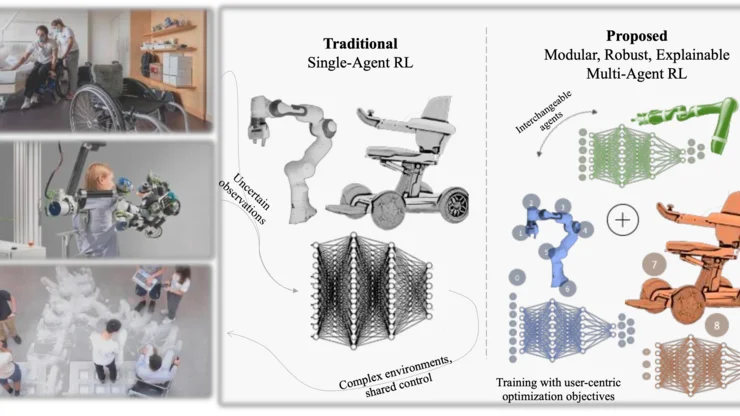

Die Gruppe „Embodied Mobile Agents“ konzentriert sich auf die Weiterentwicklung des Lernens mobiler Roboter und der verkörperten Intelligenz, wobei der Schwerpunkt auf menschenzentrierten und agentenbasierten KI-Systemen liegt. Unsere Expertise umfasst verstärktes Lernen, Lernen durch Demonstration und Sim-to-Real-Transfer für Vierbeiner, Humanoide und mobile Manipulatoren. Wir entwickeln Vision-Language-Action (VLA)-Modelle und natürliche Sprachschnittstellen, die eine intuitive Zusammenarbeit zwischen Menschen und Robotern ermöglichen. Die Anwendungsbereiche reichen von Rehabilitationsrobotik und Mobilitätshilfen über Bautraining und Digital Twinning bis hin zu sicheren und adaptiven humanoiden Systemen in Arbeitsabläufen im Gesundheitswesen. Durch die Kombination von modernstem maschinellem Lernen mit angewandter, interdisziplinärer Forschung wollen wir eine verkörperte KI schaffen, die intuitiv, adaptiv und sozial relevant ist.

Angebote

- Einblicke: Keynotes, Schulungen

- KI-Beratung: Workshops, Expertenunterstützung, Beratung, Technologiebewertung

- Forschung und Entwicklung: kleine bis große Kooperationsprojekte, von Dritten finanzierte Forschung, Studentenprojekte, kommerziell nutzbare Prototypen

Team

Projekte

-

Humanoid Robots for Cleaning and Sterilization of Medical Equipment (HERCULES)

This project develops AI-driven humanoid robot automation for hospital sterilization departments (CSSDs). Combining robotic foundation models with environment-aware whole-body control, we enable autonomous handling of surgical instruments and sterile containers, validated with pilots in hospitals.

laufend, 05/2026 - 04/2028

-

Explainable RL and Agentic Physical AI for Assistive Mobile Manipulation (CareBot)

Human-Centric and Explainable Robot Learning for Mobile Manipulation: Vision-Language-Action models and Reinforcement Learning assistive mobility and humanoids in healthcare, with Swiss industry and academic partners

laufend, 04/2026 - 03/2028

-

Avatar Demo: VR-Steuerung für humanoiden Roboter

AVATAR ermöglicht Besucher:innen, einen humanoiden Roboter per VR zu steuern, durch seine Augen zu sehen und Objekte intuitiv zu manipulieren.

laufend, 01/2026 - 07/2026

-

Talking Bots: Interactive Voice Interface for Humanoid Robots in Networking Events

Talking Bots: Interactive voice interface for humanoid robots in networking events with context-aware conversational capabilities.

abgeschlossen, 10/2025 - 12/2025

-

Robot Assistant with Physical Agentic AI

Humanoid Robot Assistant with Physical Agetic AI: Towards general robotics for mobile manipulation with adaptability across tasks and environments.

abgeschlossen, 10/2025 - 03/2026